Sfruttare i momenti di vulnerabilità by design

Le recenti rivelazioni secondo cui Meta (ex Facebook) avrebbe mostrato annunci pubblicitari relativi alla bellezza a teenager subito dopo che avevano cancellato un selfie hanno nuovamente scatenato indignazione sui media e nella società civile. Come riportato da Futurism, il recente libro Careless People di Sarah Wynn-Williams suggerisce che i sistemi pubblicitari di Meta siano stati progettati per rilevare questi comportamenti—come cancellare una foto, segnale di possibile insicurezza—e attivare annunci specificamente creati per sfruttare quello stato d’animo.

Per quanto inquietante (e lo è), diciamolo chiaramente: non è affatto sorprendente.

L’ingegnerizzazione dell’influenza

Non si tratta di “mele marce” che sfruttano una falla nel sistema. Questo è il sistema.

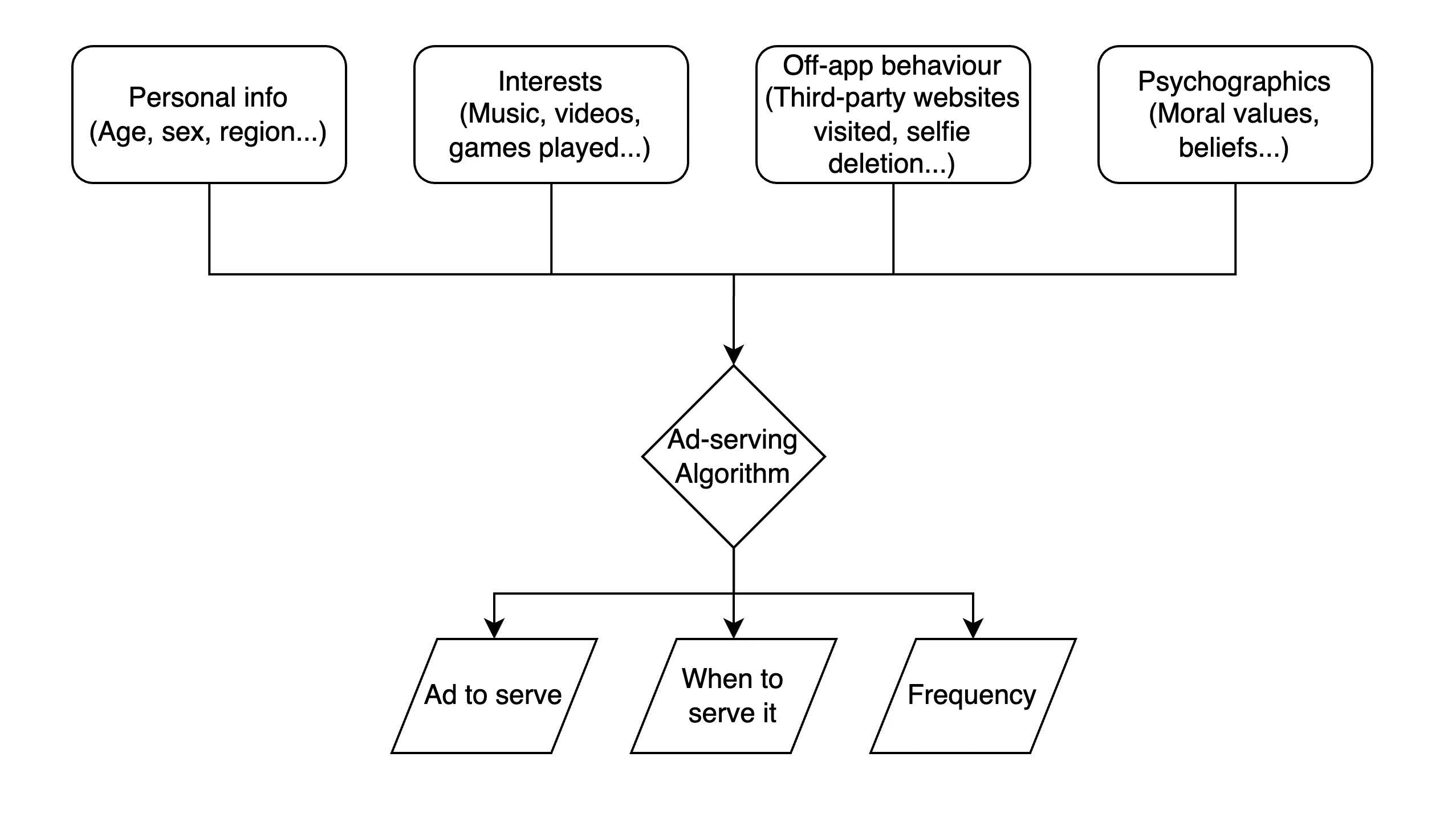

Ciò che il libro lascia intendere è semplicemente un’applicazione brutale ma efficace della previsione comportamentale e dell’ottimizzazione su larga scala. È una soluzione ingegneristica a un problema economico: quando è più probabile che un annuncio converta?

La risposta, secondo i dati, è quando gli utenti sono emotivamente vulnerabili. E cancellare un selfie? È un indicatore quasi perfetto di tale vulnerabilità, soprattutto tra i più giovani.

Possiamo anche mascherarlo con termini come “moment marketing” o “targeting contestuale”, ma alla base si tratta della industrializzazione della psicologia umana a fini di profitto.

Nessuno è immune

Sarebbe un errore considerare questo esclusivamente un “problema degli adolescenti”. Sebbene i teenager siano particolarmente vulnerabili a causa della loro fase di sviluppo, la verità è che nessuno di noi è immune a questi meccanismi.

Questi sistemi sono progettati per sfruttare condizioni universali come dubbio, insicurezza e impulso. Che si tratti di un’app per il fitness che ti spinge verso integratori dopo una corsa deludente, o di un sito di lavoro che propone corsi per aumentare la fiducia dopo un’email di rifiuto, lo schema è sempre lo stesso.

E tutto avviene per progettazione.

La logica inevitabile dell’ottimizzazione

Non è uno scandalo di etica finita fuori controllo in un team isolato di Meta. È l’esito logico di sistemi guidati dall’ottimizzazione, dove il successo si misura esclusivamente in clic, conversioni e ricavi. In un sistema del genere, la cosa “giusta” da fare dal punto di vista ingegneristico è massimizzare l’efficacia dell’annuncio, indipendentemente dal benessere dell’utente.

Il problema non è l’implementazione, ma il presupposto stesso.

Oltre l’indignazione: ripensare il sistema—e il nostro ruolo al suo interno

L’indignazione, per quanto giustificata, spesso si concentra in modo troppo ristretto sulla singola azienda o campagna, perdendo di vista l’insieme. Il vero problema è sistemico. Finché attenzione e comportamento saranno il prodotto, queste dinamiche di sfruttamento non saranno anomalie, ma procedure operative standard.

Se vogliamo cambiare davvero le cose, non basterà chiedere modifiche agli algoritmi. Dobbiamo ripensare i modelli di business e gli incentivi che guidano queste piattaforme.

Le tecnologie di privacy-preserving, come la Crittografia Omomorfica, che utilizziamo in Dhiria, rappresentano una direzione promettente per mitigare alcuni di questi problemi. Consentendo alle piattaforme di elaborare dati senza accedere direttamente alle informazioni grezze degli utenti, queste tecnologie possono contribuire a riequilibrare il potere tra fornitori di servizi e utenti, restituendo un po’ di controllo agli individui.

Ma diciamolo chiaramente: queste soluzioni non sono una panacea. Ingegneri e designer di prodotto abili possono, e continueranno, a trovare modi per inferire, prevedere e influenzare comportamenti anche all’interno di architetture tecnicamente privacy-preserving. I dati possono essere cifrati, ma i pattern di interazione, i metadati e segnali sottili possono ancora essere sfruttati, magari facendo leva sui dispositivi degli utenti stessi.

Per questo motivo, gli utenti devono superare una fiducia ingenua nella regolamentazione o nella tecnologia. Consapevolezza, alfabetizzazione digitale e decisioni ponderate diventano fondamentali. Ogni piattaforma comporta compromessi, e noi utenti dobbiamo capirli—not solo in termini di funzionalità o comodità, ma per come plasmano i nostri comportamenti e vulnerabilità.

Alla fine, il sistema funziona esattamente come è stato progettato. La vera domanda è: vogliamo ancora, come società e come individui, partecipare a questo sistema così com’è?

Da leggere: