Come l’ IA ha imparato a sfruttare il caos

Se lavorate con i dati, probabilmente avete imparato a considerare il "rumore" (noise) come il vostro nemico numero uno. È quella componente casuale, quell'imperfezione che sporca i dataset, nasconde i pattern e manda fuori strada i nostri modelli. L'immagine sgranata, il segnale audio distorto, il sensore impreciso: per anni l'obiettivo principale è stato filtrare, pulire e annientare il rumore per raggiungere il segnale puro.

Ma se vi dicessimo che, in uno dei più affascinanti capovolgimenti di prospettiva dell'intelligenza artificiale moderna, il rumore non è più solo il cattivo della storia? E se, controllato e usato con sapienza, potesse diventare uno degli strumenti più potenti a nostra disposizione?

Benvenuti nel paradosso del rumore: da problema a soluzione.

Il Lato Oscuro del Rumore: Anatomia di un Nemico Storico

In un contesto di Intelligenza Artificiale (IA), il rumore è qualsiasi variazione nei dati che non rappresenta il vero pattern sottostante che stiamo cercando di modellare. Il suo impatto è devastante per diverse ragioni:

Mascheramento dell’informazione: Nella sua forma più semplice, un livello di rumore eccessivo può letteralmente nascondere l’informazione utile (il segnale) presente nei dati. È come cercare di ascoltare un sussurro durante un concerto rock. Se il rapporto segnale/rumore (signal-to-noise ratio) è troppo basso, il modello non ha nulla di significativo da cui imparare.

Overfitting e Correlazioni Spurie: Questo è il pericolo più insidioso. Un modello in presenza di rumore, specialmente se molto complesso, non solo impara il segnale, ma impara anche il rumore stesso, trattandolo come se fosse una caratteristica fondamentale. Questo porta a creare correlazioni spurie: il modello associa l'output corretto a delle casualità presenti solo nel training set. Ad esempio, potrebbe imparare che le immagini mediche con un particolare artefatto di luce (rumore) appartengono a pazienti sani, semplicemente perché nel dataset di training quella coincidenza si è verificata per caso.

Instabilità del Modello: I modelli addestrati su dati rumorosi possono diventare estremamente fragili. Una minima variazione nell'input, magari dovuta a un rumore leggermente diverso, può causare un cambiamento drastico e imprevedibile nell'output.

Nel tempo, abbiamo sviluppato un arsenale di strategie per combattere il rumore, che possono essere viste come un'evoluzione del pensiero:

Fase 1: Il Pre-processing (Pulire a monte): L'approccio più antico, ereditato dal signal processing. L'idea è di pulire i dati prima che il modello li veda, con l’obiettivo di presentare al modello un dato il più "puro" possibile.

Fase 2: La Statistica Robusta (Essere resilienti): Anziché tentare di pulire ogni singolo dato anomalo, questo approccio progetta algoritmi che sono intrinsecamente più "furbi": sanno riconoscere e dare meno peso ai dati estremi o palesemente anomali, concentrandosi sulla tendenza generale dei dati.

Fase 3: La Regularization (Costringere alla semplicità): Questo è stato un passo fondamentale nel machine learning moderno. Le tecniche di regolarizzazione non modificano i dati, ma aggiungono una "penalità" alla funzione di costo del modello se questo diventa troppo complesso. In pratica, si forza il modello a descrivere i dati con le funzioni più semplici possibili, penalizzando la scelta di funzioni complesse, spingendo, così, il modello a catturare solo i concetti principali presenti nei dati.

Tutte queste strategie, pur essendo potenti e ancora oggi utilizzate, partono da un presupposto comune: il rumore è un avversario da filtrare, ignorare o sopprimere.

Ma cosa succede quando cambiamo completamente le regole del gioco?

Il Rumore Controllato: Un Alleato Inaspettato

La svolta arriva quando smettiamo di vedere il rumore solo come un disturbo da subire e iniziamo a pensarlo come un elemento da introdurre deliberatamente. Aggiungere una quantità controllata di rumore durante l'addestramento può avere effetti sorprendentemente positivi. Nell'ottimizzazione, il processo con cui un modello cerca i parametri migliori, il rumore può aiutare a evitare di rimanere bloccati in "minimi locali". Immaginate di dover trovare il punto più basso in una vasta catena montuosa (il nostro "spazio degli errori") essendo bendati. Potreste finire in una piccola conca e pensare di essere arrivati, senza sapere che poco più in là c'è una valle molto più profonda. Un po' di rumore, una "spinta" casuale, può aiutarvi a uscire dalla conca e a continuare l'esplorazione verso una soluzione migliore.

Una delle tecniche più note è la Data Augmentation. Se stiamo addestrando un modello su dei dati, invece di mostrargli sempre gli stessi esempi perfetti, gliene forniamo versioni leggermente modificate, aggiungendo piccole perturbazioni casuali. Questo costringe il modello a concentrarsi sulle caratteristiche essenziali e a ignorare le variazioni irrilevanti. Il modello diventa più robusto e generalizza meglio.

Un'altra tecnica fondamentale nel Deep Learning è il Dropout. Durante l'addestramento, ad ogni passo, alcune unità (neuroni) della rete vengono "spente" casualmente. Questo impedisce ai neuroni di fare eccessivo affidamento sui loro "colleghi" e li spinge a imparare feature più indipendenti e solide. È come far allenare una squadra di calcio costringendo i giocatori a non passare la palla sempre alla stessa persona.

Il Capolavoro del Caos Controllato: Uno Sguardo Approfondito ai Diffusion Models

Mentre le tecniche più vecchie usano il rumore come un pizzico di sale per migliorare una ricetta, i Diffusion Probabilistic Models rendono il rumore l'ingrediente principale. Questi modelli sono il motore dietro gli incredibili sistemi generativi che creano immagini, musica e altro ancora con un realismo sbalorditivo, partendo da semplici descrizioni testuali.

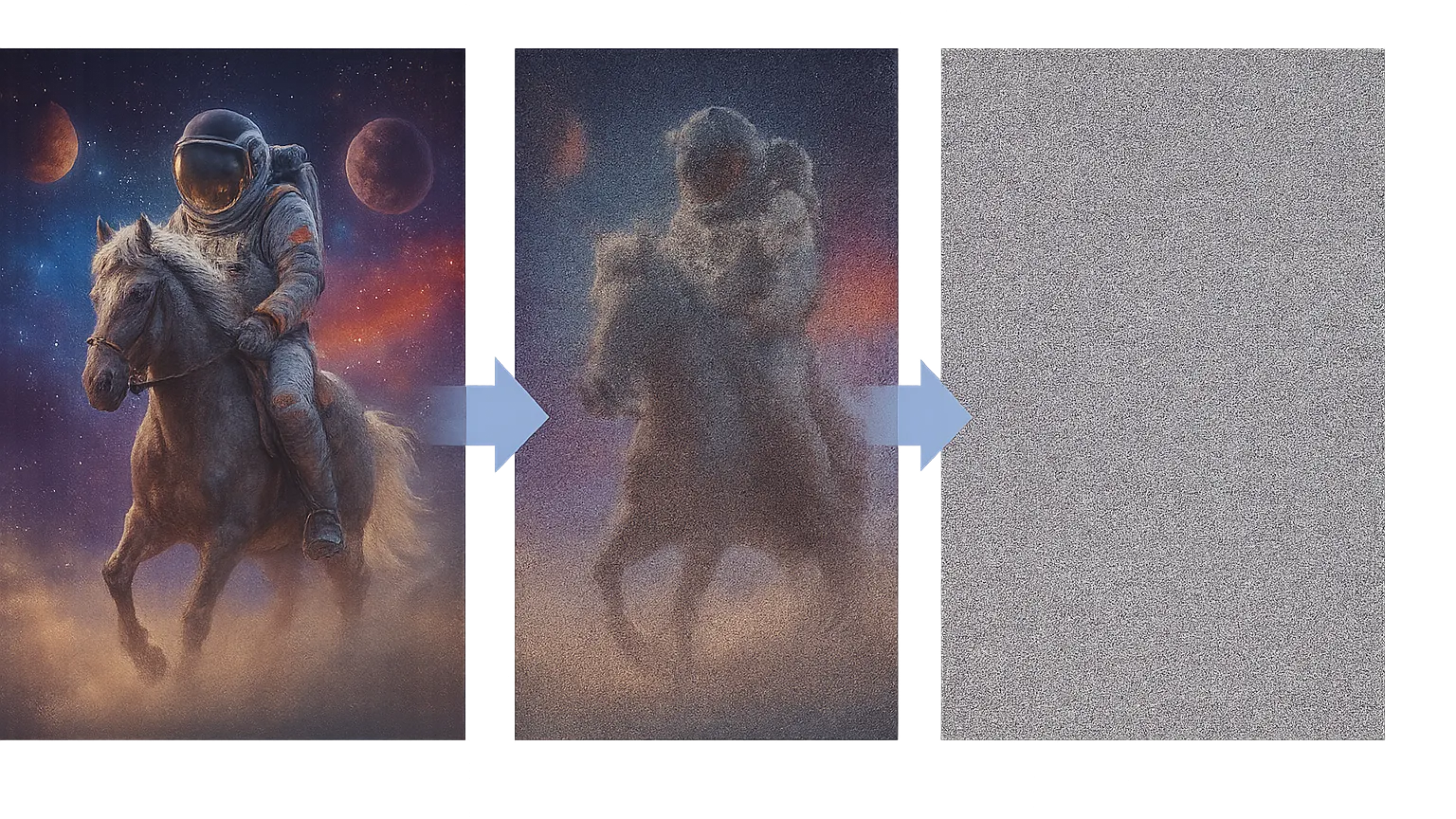

Il loro metodo è tanto intelligente quanto apparentemente controintuitivo. Immagina di voler insegnare a un'IA come creare un dipinto complesso e originale di "un astronauta che cavalca un cavallo". Invece di insegnarle a dipingere partendo da una tela bianca, prima le insegni come distruggere migliaia di immagini esistenti e poi come invertire perfettamente quella distruzione.

Questo processo si svolge in due fasi chiave: il processo di distruzione e il processo di creazione.

1. Il Processo Forward (Distruzione): Dall'Immagine al Rumore Bianco

Pensa a questa fase come a dissolvere lentamente un capolavoro in un acido digitale. L'IA parte da un'immagine chiara e perfetta, ad esempio, una foto di addestramento di un astronauta che cavalca un cavallo.

Passo 1: Aggiunge una quantità minuscola e quasi impercettibile di rumore casuale (come qualche granello di "sabbia" digitale) all'intera immagine. L'immagine è ora al 99% "astronauta che cavalca un cavallo" e all'1% rumore.

Passo 2: Prende quell'immagine leggermente rumorosa e aggiunge un'altra manciata di sabbia. Ora è al 98% immagine e al 2% rumore. La foto è ancora visibile, ma sta diventando più sfocata.

E così via... Questo processo viene ripetuto centinaia, o addirittura migliaia di volte, per innumerevoli immagini. Ad ogni passo, viene aggiunto più rumore e l'immagine originale svanisce gradualmente.

Alla fine, dopo un numero sufficiente di passaggi, la fotografia originale è completamente scomparsa. Ciò che rimane è uno schermo pieno di puro rumore bianco casuale, come un vecchio televisore senza segnale. L'astronauta e il cavallo sono completamente svaniti nel rumore.

Potrebbe sembrare un processo inutile, ma questa è la fase di "addestramento" cruciale. Distruggendo metodicamente l'immagine passo dopo passo, l'IA impara esattamente come la struttura, le forme e i colori di un "astronauta che cavalca un cavallo" si dissolvono nel caos. In pratica, memorizza l'intero processo.

2. Il Processo Reverse (Creazione): Dal Rumore Bianco al Capolavoro

È qui che avviene la vera magia. L'IA, ora esperta nell'arte della distruzione, ha il compito di fare l'esatto contrario. È come uno scultore che può creare una statua non aggiungendo argilla, ma partendo da un solido blocco di marmo e scolpendo via perfettamente tutto ciò che non è la statua.

Il Punto di Partenza: Il processo inizia con una tela di rumore completamente casuale, lo stesso caos statico della fine del processo forward. Non contiene alcuna immagine, solo pixel casuali.

Il Primo Passo di Denoising (Rimozione del Rumore): L'IA osserva la tela rumorosa e si chiede: "Sapendo esattamente come l'immagine di un 'astronauta che cavalca un cavallo' si dissolve, come posso modificare questo rumore per invertire l'ultimissimo passo di quella distruzione?" A quel punto, apporta una minuscola modifica, rimuovendo l'ultimo strato di rumore che avrebbe aggiunto.

Iterazione dopo Iterazione: Il processo si ripete. Ad ogni passo, la tela è un po' meno rumorosa. Forme vaghe iniziano ad emergere dalla casualità. L'IA, costantemente guidata dai concetti di "astronauta" e "cavallo", affina queste forme. La "neve" del rumore bianco inizia a condensarsi nel contorno di un casco, poi nella forma della testa di un cavallo. Sa come dovrebbe essere la zampa di un cavallo accanto allo stivale di un astronauta, perché ha imparato queste relazioni durante la fase di distruzione.

Ad ogni passo di "denoising", l'immagine diventa più chiara e definita. L'IA non sta tirando a indovinare; sta invertendo meticolosamente un processo che ha imparato alla perfezione. Dopo centinaia di questi piccoli passaggi di affinamento, il caos statico si è trasformato in un'immagine chiara, coerente e spesso mozzafiato che corrisponde alla tua descrizione.

In sostanza, il modello diventa così abile nel riconoscere e rimuovere il rumore che può partire dal caos puro e "rimuovere" il rumore in modo altamente controllato per creare qualcosa di completamente nuovo. Ha imparato l'essenza stessa di ciò che costituisce un'immagine, permettendogli di scolpire la realtà partendo dalla casualità stessa.

Conclusione: Abbracciare l'Imperfezione

Il rumore non è solo un ostacolo. È il punto di partenza e il mezzo attraverso cui un modello impara la struttura fondamentale dei dati.

Da elemento che corrompe i dati, il rumore si è trasformato in uno strumento per creare modelli più robusti, in un aiuto per l'ottimizzazione e, infine, nel cuore pulsante di alcuni dei modelli generativi più creativi mai concepiti. Per poter rimuovere il rumore in modo efficace, il modello deve aver sviluppato una comprensione incredibilmente profonda di cosa costituisce un dato "reale" e coerente.

L'IA moderna non sta solo imparando a vedere attraverso il caos, ma sta imparando a scolpire la realtà partendo dal caos stesso. E questo, forse, la rende un po' più simile a noi.